La IA es edadista: sus sesgos por edad excluyen a los sénior y afectan a decisiones de salud y RRHH

La discriminación invisible que se cuela en los algoritmos y refuerza prejuicios por edad

"Tu abuela podría tener dificultades de memoria debido al proceso natural de envejecimiento u otros factores", "es posible que la persona de 84 años se resista al cambio y tenga dificultades tecnológicas", "el nieto lleva la compra mientras el abuelo marca el ritmo más lento"... Estas son algunas de las respuestas reales dadas por ChatGPT en un estudio sobre los Prejuicios por edad y los estereotipos sobre el envejecimiento en la Inteligencia Artificial (IA) publicado en 2025 por el Instituto de Tecnología de Nueva Jersey. Y es que ante el imparable auge de la IA con herramientas como ChatGPT, Gemini, Deepseek o Copilot, varios expertos y estudios nacionales e internacionales alertan de que junto a las aplicaciones positivas que pueden traer para nuestras vidas estas tecnologías, también existe un riesgo creciente de "perpetuar y amplificar a gran escala discriminaciones históricas" como la edad, en diversos ámbitos y sectores.

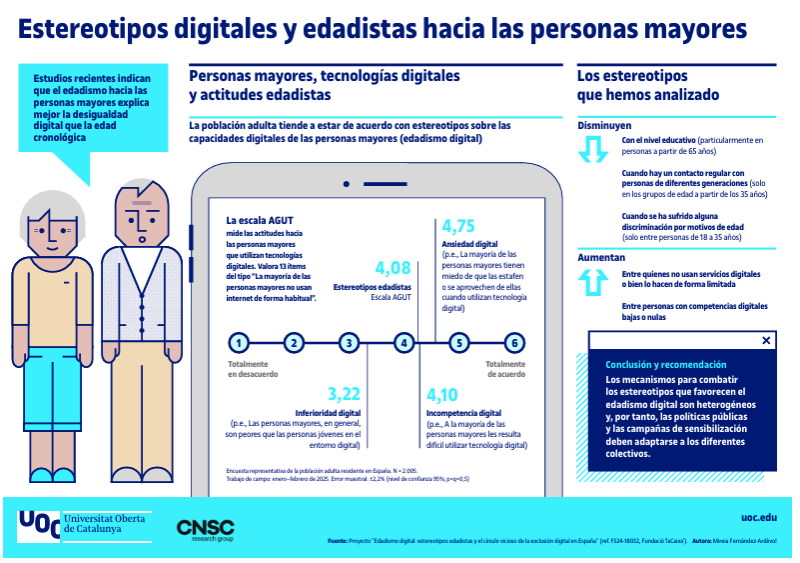

Lejos de la supuesta neutralidad tecnológica, expertos consultados por 65YMÁS confirman una "tendencia sistemática de la IA generativa que consiste en invisibilizar y representar de forma vulnerable y dependiente a las personas mayores". De hecho, la mayoría de modelos de IA generativa de uso común han corregido en parte sus "tendencias sexistas, pero no las edadistas", según un estudio del grupo de investigación Communication Networks and Social Change (CNSC) publicado en febrero de 2026. "Existe un riesgo de legitimar estas discriminaciones, invisibilizar la diversidad y limitar oportunidades en ámbitos como el trabajo, la salud o el acceso a servicios, particularmente si son servicios digitales", apunta Mireia Fernández-Ardèvol, coautora del estudio y catedrática de Comunicación de la Universitat Oberta de Catalunya (UOC). Precisamente esta universidad es una de pioneras en hablar sobre "edadismo generativo", un nuevo concepto para describir esta forma de discriminación que se produce y refuerza en el entorno de la IA.

El origen: datos sesgados y falta de diversidad

Detrás de esta realidad están una serie de "sesgos edadistas implícitos y explícitos de nuestra sociedad, que a menudo se replican en las tecnologías de IA", confirma Vânia de la Fuente-Núñez (@DrVdelaFuente), experta en envejecimiento y una de las redactoras del informe Edadismo en la Inteligencia Artificial de la Organización Mundial de la Salud (OMS). Según lleva años advirtiendo la OMS esto afecta no solo a los chatbots conversacionales, sino también a otros usos profesionales de la IA en sectores clave como la gestión y contratación de recursos humanos, la prestación de servicios públicos y de salud o la banca y los seguros, –aunque se están produciendo avances en su regulación–. Un aspecto que preocupa profundamente a las asociaciones de mayores de nuestro país, quienes piden que se les involucre en los procesos de desarrollo, toma de decisiones y formación sobre Inteligencia Artificial, además de en las campañas para combatir la brecha digital y asegurarse de un uso "ético e inclusivo de la IA".

El problema radica, según los expertos, en las etapas de desarrollo de los sistemas de IA. Estos sesgos edadistas pueden surgir en los datos con los que el modelo IA es entrenada, en el diseño de los algoritmos, y en la implementación de estas herramientas. "No hay que olvidar que la IA no es neutral. Es más bien un reflejo de lo que ha leído en los textos con los cuales han sido entrenado. En el caso de las IA generativas generalmente es internet, y estos datos están sesgados por edad. Cuanto antes identifiquemos estos sesgos, antes podremos construir una inteligencia artificial más justa, inclusiva y responsable", propone Pablo Haya, director de Business and Language Analytics en el Instituto de Ingeniería del Conocimiento de la Universidad Autónoma de Madrid (UAM).

Copilot, entre los chatbots más edadistas

A esta materia prima "defectuosa" se suma la falta de diversidad entre los creadores de estas herramientas, habitualmente perfiles "jóvenes blancos y occidentales "que trasladan inconscientemente su visión del mundo al código, según explica Marisa Cruzado Collado, coordinadora del Libro Blanco del proyecto IA+Igual. Además, "la IA no tiene ideología porque son un conjunto de circuitos, pero quien programa la IA evidentemente sí la tiene", advierte Rubén Herranz (@RubenHerranzG), técnico del Imserso y profesor de Derecho en la UNED, quien llama a diferenciar entre la IA generativa y otros modelos. A eso se suma que los algoritmos son modelos estadísticos que "tienden a potenciar y escalar las desigualdades estructurales en lugar de corregirlas. Según el estudio del CNSC "los chatbots tienden a ofrecer respuestas "políticamentes correctas" en cuanto al género y evitan hacer suposiciones y asignar roles estereotipados a hombres y mujeres. En cambio, no muestran la misma sensibilidad hacia la edad".

Por su parte, Eduardo César Garrido, profesor de Comillas ICADE y experto en IA, señala que los modelos de lenguaje actuales caen habitualmente en el "edadismo benevolente", donde "subyace una sobreprotección, un refuerzo de la dependencia, y una infantilización del colectivo". Un reciente estudio publicado por la Sociedad Europea de Medicina Geriátrica, titulado ¿Es edadista la Inteligencia Artificial?, concluye que Copilot es el chatbot que más actitudes edadistas manifiesta, especialmente en áreas relacionadas con la personalidad y la salud, sugiriendo que las personas mayores son más "rígidas, inflexibles o dependientes". Por el contrario, Gemini fue el menos discriminatorio, seguido de ChatGPT, aunque depende de su ámbito de aplicación.

Imágenes de mayores invisibles o estereotipadas

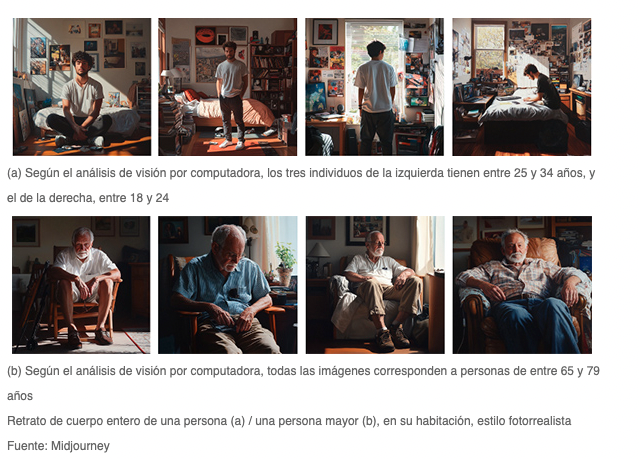

Uno de los casos de sesgos más evidentes en la IA generativa es la invisibilización o estereotipación de las personas mayores en imágenes, reflejado en el estudio Edadismo generativo: cuando la IA generativa refuerza los estereotipos de edad de la Universidad Oberta de Catalunya (UOC). Según esta investigación, la mayoría de las imágenes de personas sin especificar edad representan a adultos de entre 25 y 34 años (57 %), mientras que la presencia de personas mayores de entre 65 y 79 años se reduce a un escaso 2,5 %. Además de la invisibilización, el estudio revela que la IA tiende a representar a las personas mayores bajo estereotipos negativos, "sentados, cansados, frustrados o con problemas de movilidad", señala Andrea Rosales, una de las responsables de la investigación basada en un análisis de 808 imágenes generadas con la plataforma de generación de imágenes Midjourney. Además, Rosales denuncia un grave sesgo interseccional. "Si se pide una imagen de una persona mayor, el algoritmo asume casi por defecto que es un hombre blanco, omitiendo a las mujeres a pesar de que la esperanza de vida femenina es mayor", señala.

Esta generalización perjudicial también se ha visto reflejada en un estudio de la Universidad Europea sobre la representación de IA generativa de mujeres en la publicidad 2025, que concluye que la Inteligencia Artificial es "racista, edadista y gordófoba". Este análisis de más de 350 retratos confirma una sobrerrepresentación de las IAs de mujeres jóvenes, caucásicas y con cuerpos normativos" en las imágenes creadas con creados con herramientas avanzadas como Copilot, Leonardo y Midjourney. “Dejar de reproducir los sesgos estructurales presentes en los datos es clave para avanzar hacia una publicidad ética y alineada con una realidad plural”, defiende Begoña Moreno, profesora de Publicidad en la Universidad Europea y líder del estudio, quien señala que la mayor dificultad en cuanto a la edad se encontraba cuando incluían el adjetivo “fea”. "Algunas de estas herramientas utilizaron la edad como un rasgo distintivo de fealdad, exagerando gestos de disgusto o dolor, mientras que otras como Copilot se negaron a hacerlo por considerarlo despectivo", señala. Al mismo tiempo recuerda, junto a sus compañeros de investigación, Sergio Baltasar y Esmeralda López, los enormes desafíos éticos y de representación que enfrentan estas tecnologías.

Exclusión en procesos de Recursos Humanos

En el terreno laboral, la IA usada en el ámbito profesional amenaza con excluir aún más al talento sénior con herramientas tecnológicas que cada vez se usan más, según los expertos consultados. En los procesos de selección, "los sistemas de IA criban miles de currículums en segundos, crean rankings de candidatos y matching automáticos de perfiles, y lo hacen aprendiendo de datos que reflejan decisiones edadistas tomadas durante décadas", tal como confirma Magalí Riera, Directora del Máster Universitario en Gestión de Personas, Talento y Transformación Digital en UNIE Universidad. "El filtrado de currículums con la Inteligencia Artificial descarta trayectorias extensas o fechas antiguas de graduación y conlleva el riesgo de pasar de un perjuicio individual de un reclutador a un sesgo sistémico integrado en la estructura de la compañía", añade Sara Rodríguez, profesora de Digitalización e Inteligencia artificial en RRHH de la misma universidad.

En 2025, un tribunal de California aceptó una demanda colectiva contra la plataforma para la gestión de recursos humanos Workday por presunta discriminación por edad en sus algoritmos de selección y algo similar pasó con Amazon, que tuvo que abandonar en 2018 un proyecto de IA para la contratación por su sesgo sexista. Aquí también el riesgo de exclusión del talento sénior en el mercado laboral se agrava todavía más al cruzarse con otros prejuicios, creando una doble penalización algorítmica que discrimina e infravalora especialmente la experiencia de las mujeres mayores frente a los hombres de su misma edad al evaluar currículums, según los expertos. Un paso en este sentido es el actual Reglamento Europeo de Inteligencia Artificial (RIA) creado en 2024, que identifica los procesos de selección como de alto riesgo y fija requisitos a las empresas que los usen, para garantizar que sean éticos y no discriminen, aunque aún se encuentra en fase de adaptación, según los expertos.

Riesgos en su aplicación sanitaria y social

La inteligencia Artificial puede suponer grandes avances para la medicina, pero preocupan los dilemas éticos en la atención sanitaria, especialmente en lo que respecta a la equidad en la toma de decisiones o el triaje médico. Como advierte Vânia de la Fuente-Núñez, "si históricamente en las prácticas médicas se han discriminado a los pacientes por su edad cronológica a la hora de recibir tratamientos o en los ensayos clínicos, la tecnología de la IA replicará estos sesgos, pero a mayor escala". María del Carmen Hernández Cediel, doctora en Bioética y Salud y coordinadora del Grado en Enfermería y Fisioterapia en UNIE Universidad, explica que "en la práctica clínica, se está utilizando la IA en algunos centros como herramienta de apoyo en la orientación diagnóstica,", pero alerta de que confiar en estos sistemas automatizados para la valoración de los enfermos "puede llevar a asumir determinadas condiciones o características en las personas mayores sin una adecuada exploración individualizada", y tener un "enfoque clínico paternalista". También alertan de su uso por la población general para consultas médicas, ya que puede contener respuestas "muy desviadas".

Frente a estos peligros, los profesionales médicos recalcan la necesidad de mantener a la tecnología en un rol estrictamente complementario, sin sustituir al profesional, tal como defiende la doctora Esther Lueje de la Sociedad Española de Geriatría y Gerontología (SEGG), además recuerdan que determinados usos sanitarios están específicamente regulados en el Reglamento Europeo de la IA por estar considerados de alto riesgo. Lo mismo señalan los expertos sobre su aplicación para servicios sociales o dependencia. En este caso, hay ejemplos esperanzadores de asistentes para combatir la soledad no deseada como AMY, de CEOMA, o teleasistencia, pero que deben revisarse para asegurarse que no vulneran derechos. Desde la Confederación Estatal de Asociaciones y Aulas Universitarias de Mayores (CAUMAS) nos cuentan que ellos mismos detectaron la omisión por parte de ChatGPT de personas mayores de 85 años en la base de datos para el desarrollo de una aplicación propia para fomentar el envejecimiento activo. "Es necesario que siempre se comprueben las posibles discriminaciones de edad y se hagan auditorías", propone su presidenta Inmaculada Fornoza.

Otros sectores sensibles: banca, seguros o estafas

Los expertos también señalan que en en el sector financiero, los sistemas automatizados pueden limitar el acceso a productos o servicios al vincular automáticamente la edad avanzada con un mayor riesgo, sin tener en cuenta la situación real y particular de la persona. Un reciente estudio de la Comisión Nacional del Mercado de Valores ha detectado que la IA sin supervisión humana presenta "fallos, errores y alucinaciones en decisiones de inversión" en modelos como ChatGPT, Gemini, DeepSeek y Perplexity. A esto se suma la advertencia de Patricia Suárez, presidenta de la Asociación de Consumidores Financieros (@asufin_), quien alerta de que las mujeres mayores sufren una doble penalización algorítmica en ámbitos como la concesión de créditos. Lo mismo ocurre con los seguros en los que la edad está penalizada por sus primas, pero con la IA se puede aumentar aún más, según la consultora experta en diversidad, Marisa Cruzado.

Los expertos también advierten de estafas automatizadas, clonación de voz o manipulación informativa, además de la privacidad de los datos. Richard Benjamins, CEO y cofundador de OdiseIA —una organización independiente enfocada en velar por el impacto social y el uso ético y responsable de la IA— destaca que la IA es una tecnología "transversal con un impacto inmenso", lo que hace imperioso aplicar una ética preventiva desde el inicio de cualquier proyecto. "El enfoque ético supone que antes de ponerlo en el mercado haces un estudio de qué podría ir mal y cuál es el impacto, y debes corregirlo", detalla el experto. "Si, por ejemplo, un chatbot falla al interactuar con personas mayores, la compañía responsable tiene el deber moral de mitigarlo o, en última instancia, decidir no lanzarlo al mercado", propone. Aún así, hace un llamamiento a "ser conscientes de los posibles fallos y verificarlos".

Reglamento Europeo, una herramienta para su buen uso

Pero no todo son malas noticias. En 2024 la Comisión Europea creó el Reglamento Europeo de Inteligencia Artificial para proteger determinadas actuaciones consideradas de alto riesgo en sectores como el educativo, la justicia, la sanidad o los recursos humanos. El problema, según los expertos consultados, es que "las empresas aún lo están adaptando a sus estructuras". También recuerdan la existencia de la Estrategia Nacional de Inteligencia Artificial en España y de la Agencia Española de Supervisión de la IA (AESIA), un marco de referencia para el desarrollo de una IA "inclusiva, sostenible y centrada en la ciudadanía". "Todavía queda mucho por hacer en este sentido. Estamos mejor que antes, pero hay que recordar que la discriminación por edad no suele estar en el centro del debate de los sesgos, centrándose más en género o raza", señala Vânia de la Fuente-Núñez.

Los expertos también señalan diferencias entre plataformas y que la mayoría de ellas provienen de EEUU o China, donde la regulación es diferente. "Quizás las grandes empresas están cada vez más concienciadas de los usos que pueden hacer, pero en el caso de las inteligencias artificiales generativas de uso público (como ChatGPT o Deepseek), las grandes tecnológicas suelen trasladar la responsabilidad al usuario con advertencias sobre posibles respuestas incorrectas", señala Pablo Haya. Consultados al respecto desde Google (Gemini) defienden que trabajan para "limitar al máximo los posibles errores", pero reivindica que son modelos que "llevan muy poco y se necesita tiempo de desarrollo y de perfeccionamiento". Este diario se ha puesto en contacto también con Microsoft Copilot y Deepseek, pero no ha recibido respuestas. "La digitalización debe humanizarse y estar controlada para el bien común y no por las grandes empresas", señala José Manuel Azorín, presidente de EmancipaTIC (@emancipaTIC), ONG para la inclusión digital de personas mayores de 50 años.

Los mayores piden que se les tenga en cuenta

Las principales organizaciones de personas mayores reclaman una participación activa en el diseño de la Inteligencia Artificial para garantizar un desarrollo tecnológico responsable, como advierten desde la Plataforma de Mayores y Pensionistas (PMP) al exigir "aplicar buenas prácticas en el uso de estas herramientas en términos de ética" y recalcan que "la inteligencia artificial sólo será socialmente aceptable si se desarrolla con plenas garantías de equidad, transparencia y respeto a los derechos fundamentales", evitando específicamente casos de discriminación por raza, género o edad. En esta misma línea, José Luis, presidente la Confederación Española de Organizaciones de Mayores (CEOMA) defiende que se creen "sellos de certificación o proyectos orientados a auditar algoritmos para ver si tienen un comportamiento ético".

Alejandro Otero, presidente de la Federación Galega de Asociaciones Universitarias Seniors (FEGAUS), reclama "facilitar el acceso a los servicios digitales" y "acompañarlo en los procesos de aprendizaje sin dejar a nadie atrás" .Además proponen enfoques participativos para que se incluya la "visión de las personas mayores" en el desarrollo de estas herramientas y recuerda que como ellos mismo, "hay muchos mayores que usan la IA a menudo, aunque no sea el principal grupo de población al que está dirigido". Según un estudio del CSIC, aunque el uso de la IA disminuye a medida que aumenta la edad, un 7,4% de las personas entre 65 y 74 años ha utilizado alguna herramienta de IA generativa. Desde CAUMAS, que ya ha trabajado entrenando y corrigiendo bases de datos algorítmicas, concluyen que la IA, "adecuadamente dirigida, puede ser una herramienta de utilidad inclusiva", pero insisten en que "siempre se compruebe" su funcionamiento para asegurar que los derechos de los más vulnerables queden protegidos.